在大型自动化场景中,单台3D相机的视野往往难以覆盖整个作业范围。于是,3D视觉引导系统越来越多地采用多相机协同方案――多台相机从不同角度、不同位置同时采集数据,共同完成对大场景或复杂工件的感知与定位。然而,当多台相机同时工作时,一个极易被忽视却又足以让整个系统瘫痪的问题浮出水面:相机之间的相互干扰。

这种干扰并非简单的信号串扰,而是涉及光学、电子与数据处理的多重耦合。一旦处理不当,轻则导致点云数据出现大量噪点与空洞,重则使系统根本无法输出可靠的定位结果。

光学干扰:当相机“看见”彼此

多相机干扰最直观的表现来自光学层面。在3D视觉引导系统中,绝大多数3D相机依赖主动投影结构光或激光条纹来获取深度信息。当两台或更多相机在同一区域同时工作时,各自投射的光斑、条纹可能进入其他相机的传感器视野。

这种现象被称为“光串扰”。具体表现为点云中出现大量异常飞点、深度信息失真,甚至整个重建结果呈现雪花状噪点。对于采用全局快门的相机,干扰可能只发生在特定区域;而对于扫描式系统,干扰则可能贯穿整个采集周期。

更为隐蔽的是,某些场景下相机之间并未直接对视,但投射的光线在工件表面发生镜面反射后,仍可能被另一台相机捕获。这种间接干扰更难预测与排查,往往在现场调试阶段才暴露出来,极大拖慢项目交付进度。

时间同步:被忽视的维度

即便光学设计上避免了直接干扰,多相机系统仍面临时间同步的挑战。每台相机都有自己的采集节奏与曝光时序。当两台相机的曝光窗口在时间轴上重叠时,即便它们投射的光波长不同,由于传感器的宽谱响应特性,仍可能产生干扰。

解决这一问题的常见思路是采用时分复用――让各相机错开曝光时间,确保任一时刻只有一台相机处于投射与采集状态。然而,这种方案会直接拉长整体采集周期。对于需要快速响应的3D视觉引导场景,例如流水线上的动态抓取,采集周期的延长意味着系统吞吐量的下降,需要在抗干扰与效率之间做艰难权衡。

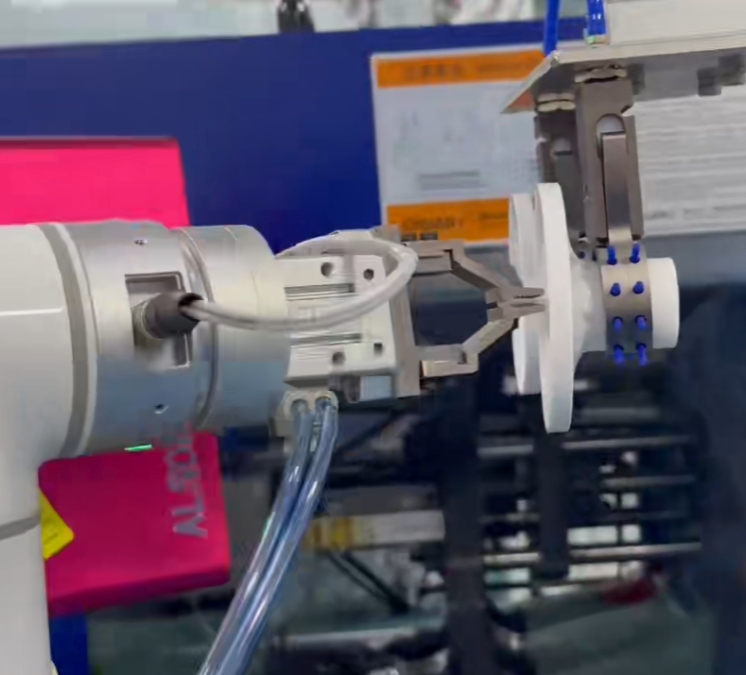

还有一类更为复杂的场景是相机与外部运动设备(如转台、机械臂)的同步。当相机自身安装在运动轴上时,各相机之间的相对位置不断变化,干扰模式也随之动态改变。静态标定下建立的干扰规避策略,在运动过程中可能完全失效。

数据融合:干扰的后遗症

即便通过硬件层面的时序控制规避了采集干扰,多相机数据融合阶段仍面临“软干扰”问题。各相机采集的点云数据需要统一到同一个世界坐标系下。这一过程依赖于高精度的联合标定。

但在实际工况中,温度变化、机械振动都会导致相机之间的相对位姿发生微小漂移。标定参数一旦失准,同一工件在不同相机视野中重建出的点云就会产生错位。融合后的点云出现“重影”,特征边缘模糊,直接导致后续的定位与引导精度下降。

更棘手的是,这种融合干扰往往被误判为算法问题,技术人员耗费大量时间调整识别算法,却忽略了根源在于多相机数据未严格对齐。

系统化设计方能破局

解决多相机干扰,不能指望单一技术手段。光学层面,需要合理布局相机位置与投射角度,避免直接对视与镜面反射路径。硬件层面,应设计可靠的时序同步机制,精确控制各相机的曝光窗口。算法层面,则需建立鲁棒的联合标定与动态补偿机制,实时监测相机间位姿变化并进行修正。

结语

3D视觉引导系统走向多相机协同是技术发展的必然趋势,但多相机干扰是这条路上无法绕开的致命陷阱。它考验的不是单一算法的优劣,而是对整个系统――从光学设计、硬件同步到软件融合――的深度理解与工程化把控。只有正视干扰的本质,从系统层面构建抗干扰能力,多相机协同才能真正释放其价值,让3D视觉引导在复杂场景中稳定、可靠地运行。