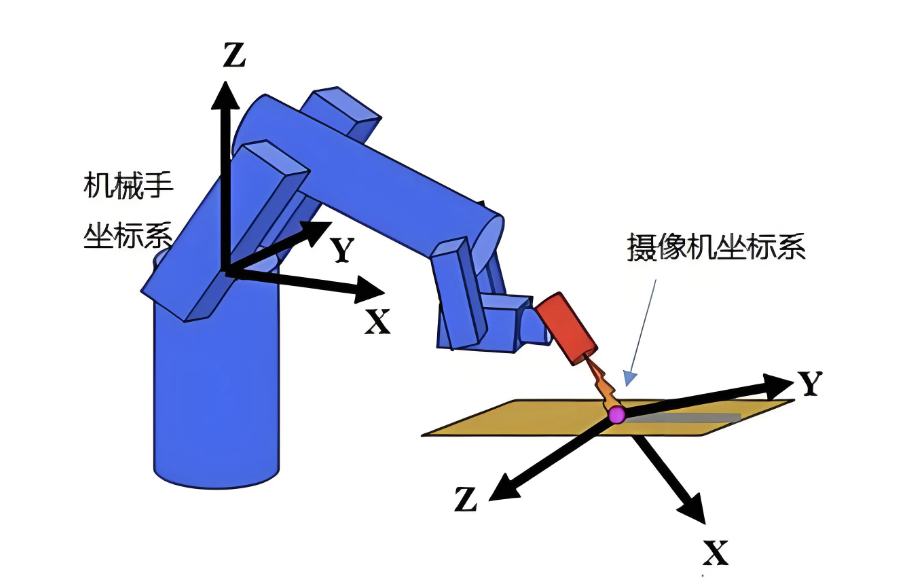

一. 手眼标定精度:误差传递与系统性问题

您已经精准地指出了问题的核心:误差的传递与放大。手眼标定不是一个孤立的步骤,而是一个系统性工程。

深化分析与解决思路:

1.标定数据的质量优于数量:

问题: 单纯增加标定板位姿的数量并不能保证精度提升。如果这些位姿都集中在机器人工作空间的一个小范围内,标定结果在外推区域会非常不可靠。

解决方案:

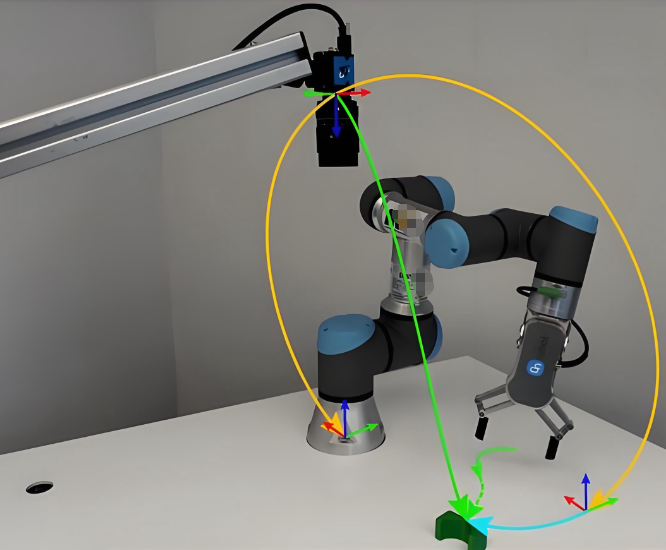

充分覆盖工作空间: 标定时,应让机器人带动标定板(Eye-to-Hand)或相机(Eye-in-Hand)尽可能覆盖整个待测工作空间,包括各个角落和不同的深度。

多样化的姿态: 标定板相对于相机需要有足够多的旋转和平移变化,特别是绕光轴方向的旋转,这对于求解旋转矩阵至关重要。

自动数据筛选: 在采集过程中或采集后,自动剔除模糊、过曝、欠曝或角点提取不准确的图像。

2.“机器人精度”是关键瓶颈:

问题: 手眼标定严重依赖机器人的绝对定位精度。如果机器人到达指定点的实际位置与理论值存在较大偏差,那么用这个有偏差的数据计算出的变换矩阵必然不准确。

解决方案:

①先进行机器人标定: 在视觉系统标定前,先对机器人进行全工作空间范围内的精度标定(如使用激光跟踪仪),补偿其几何参数误差。这是提升手眼标定精度的最有效手段之一。

②使用高精度外部测量设备: 在极端追求精度的场景下,可以使用激光跟踪仪等设备直接测量标定板在机器人底座坐标系下的真实位姿,从而绕过机器人自身的定位误差。但这成本高昂,流程复杂。

3.引入您提到的“闭环验证与补偿”:

流程:

① 完成初始手眼标定 T_cam_base。

② 让机器人移动到工作空间内多个(尤其是边缘的)验证点。

③ 相机观察一个固定在场景中的物体(或另一个标定板),通过视觉测量计算出该物体在相机坐标系下的位姿 P_obj_cam。

④ 利用 T_cam_base 将其转换到底座坐标系:P_obj_base = T_cam_base * P_obj_cam。

⑤ 同时,通过机器人读数可知工具末端相对于底座的位姿 T_tool_base,而工具与物体的相对关系 P_obj_tool 是固定的、已知的。因此,物体的理论位姿为 P'_obj_base = T_tool_base * P_obj_tool。

⑥ 比较 P_obj_base 和 P'_obj_base 的偏差。这个偏差就是手眼标定的误差。

⑦ 基于多个验证点的误差,可以建立一个空间误差补偿表或拟合一个误差模型,对未来的视觉测量结果进行实时补偿。

二. 环境光与温度稳定性:构建鲁棒的物理系统

这是将实验室原型转化为工业可用的关键一步,核心思想是隔离、稳定和适应。

深化分析与解决思路:

1.光学防护 - 主动与被动结合:

被动防护:

机械外壳: 不仅防尘、防油,更重要的是设计遮光结构,如遮光罩、迷宫式光阑,从物理上阻挡大部分环境光直接照射到被测物或相机镜头。

偏振片: 对于金属、玻璃等反光表面,使用偏振镜可以有效抑制镜面反射,提升图像质量。

滤光片: 您提到的970nm近红外光是绝佳选择。配合相应的带通滤光片,只允许以光源波长(如970nm±10nm)为中心的很窄波段的光线进入相机,可以几乎完全剔除可见光的干扰。

主动防护:

主动光源: 采用高频调制光源,相机进行同步曝光。相机只在光源闪亮的极短时间内采集信号,从而“冻结”运动并忽略持续的环境光。

多光源策略: 在结构光项目中,使用蓝色激光(相对于环境光中丰富的红光/绿光,蓝光干扰更少)或特定格栅图案,并通过算法识别和剔除不属于该图案的噪声。

2.热管理与机械稳定性:

温度控制:

恒温箱/主动冷却: 对于精度要求极高的相机(如远心镜头、高分辨率相机),将其置于小型恒温箱内,或为其配备帕尔贴效应温控器,维持其工作在恒定温度。

材料选择: 相机支架、镜头接圈等机械结构应使用低热膨胀系数的材料,如因瓦合金、碳纤维或某些特殊陶瓷。

抗振设计:

坚固的结构: 确保所有安装点牢固,整体结构刚性足。

隔振器: 在振动强烈的环境中(如冲压机旁),在相机支架和安装底座之间使用橡胶隔振垫或专业隔振器。

三. 点云数据处理链路延迟:端到端的优化

在高速应用中,“实时性”就是生命线。优化需要贯穿整个数据流水线。

深化分析与解决思路:

1.传感器端预处理(减轻主机负担):

FPGA的威力: 这是目前最主流和有效的技术。在相机内部或一个独立的采集卡上使用FPGA,可以实时完成:

图像滤波与增强(如高斯滤波、直方图均衡化)。

ROI设定,只传输感兴趣的图像区域,极大减少数据量。

对于结构光相机,完成核心的相位计算、立体匹配和点云重建。输出结果直接就是3D点云坐标,而不是原始的、数据量巨大的灰度图。这能减少80%以上的数据传输量和后续处理量。

2.数据传输优化:

接口选择: 您的总结非常准确。10GigE、CoaXPress是追求低延迟和高带宽的首选。需要注意网线/线缆质量,并优化网络驱动和配置(如Jumbo Frames)。

零拷贝技术: 在软件层面,确保相机驱动到应用程序的内存传输是“零拷贝”的,避免数据在内存间不必要的搬运,减少CPU开销和延迟。

3.算法与计算平台优化:

并行计算架构:

CUDA/OpenCL: 点云的滤波(体素化、统计滤波)、分割(RANSAC、欧式聚类)、特征计算(法线、FPFH)等都是高度并行的任务,非常适合在GPU上加速。

多线程CPU编程: 将整个处理流水线分解为多个阶段(如:采集 -> 预处理 -> 分割 -> 识别 -> 输出),每个阶段运行在独立的CPU线程上,形成流水线并行,提高整体吞吐率。

算法轻量化:

降采样: 在精度允许的情况下,首先对点云进行体素网格降采样,大幅减少点数。

简化模型: 如果只是进行简单的抓取,可能不需要完整的、密集的点云。只需提取工件的关键特征(如平面、棱边、圆心)即可完成任务,计算量大大降低。

使用传统轻量算法或轻量级神经网络,权衡精度与速度。

四.总结

这三个共性问题揭示了系统集成的本质:它不是一个简单的“拼接”工作,而是一个需要从机械、光学、电气、控制到软件算法进行全栈式协同设计和深度优化的系统工程。

手眼标定要求我们深刻理解机器人学和多传感器融合的误差模型。

环境稳定性要求我们具备工业设计和物理防护的能力。

处理延迟则挑战我们在计算机体系结构和实时计算上的功底。

成功解决这些问题的系统,才能从“理论上可行”走向“生产中可靠”。